Givet en prøve fra en normalfordeling, hvis parametre er ukendte, er det muligt at angive forudsigelsesintervaller i frekventistisk forstand, dvs., et interval baseret på statistikker for stikprøven, således at Xn+1 ved gentagne forsøg falder i intervallet i den ønskede procentdel af tiden; man kan kalde disse “prædiktive konfidensintervaller”.

En generel teknik til frekventistiske prædiktionsintervaller er at finde og beregne en central størrelse af de observerbare størrelser X1, …., Xn, Xn+1 – dvs. en funktion af observerbare størrelser og parametre, hvis sandsynlighedsfordeling ikke afhænger af parametrene – som kan omvendes for at give en sandsynlighed for, at den fremtidige observation Xn+1 falder inden for et interval, der er beregnet ud fra de hidtil observerede værdier, X 1 , … , X n . {\displaystyle X_{1},\dots ,X_{n}.}

En sådan central størrelse, der kun er afhængig af observerbare størrelser, kaldes en supplerende statistik. Den sædvanlige metode til at konstruere pivotalmængder er at tage forskellen mellem to variabler, der afhænger af sted, således at sted ophæves, og derefter tage forholdet mellem to variabler, der afhænger af skala, således at skala ophæves. den mest kendte pivotalmængde er Student’s t-statistik, som kan udledes ved denne metode og anvendes i det følgende.

Kendt middelværdi, kendt variansRediger

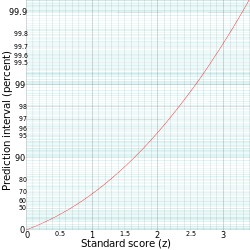

Et forudsigelsesinterval for en fremtidig observation X i en normalfordeling N(µ,σ2) med kendt middelværdi og varians kan beregnes fra

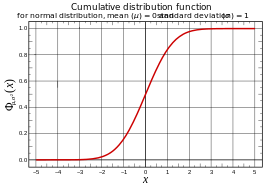

γ = P ( ℓ < X < u ) = P ( ℓ – μ σ σ < X – μ σ < u – μ σ ) = P ( ℓ – μ σ σ < Z < u – μ σ ) , {\displaystyle \gamma =P(\ell <X<u)=P\left({\frac {\frac {\ell -\mu }{\sigma }}<{\frac {X-\mu }{\sigma }}<{\frac {u-\mu }{\sigma }}}\right)=P\left({\frac {\frac {\ell -\mu }{\sigma }}<Z<{\frac {u-\mu }{\sigma }}}}\right),}

hvor Z = X – μ σ {\displaystyle Z={\frac {X-\mu }{\sigma }}}

, standardscoren for X, er fordelt som standardnormal.

Heraf

ℓ – μ σ = – z , u – μ σ = z , {\displaystyle {\frac {\ell -\mu }{\sigma }}=-z,\quad {\frac {\frac {u-\mu }{\sigma }}=z,}

eller

ℓ = μ – z σ , u = μ + z σ , {\displaystyle \ell =\mu -z\sigma ,\quad u=\mu +z\sigma ,}

med z kvantilen i standardnormalfordelingen, for hvilken:

γ = P ( – z < Z < z ) . {\displaystyle \gamma = P(-z<Z<Z<z).}

eller tilsvarende;

1 2 ( 1 – γ ) = P ( Z > z ) . {\displaystyle {\tfrac {\tfrac {1}{2}}}(1-\gamma )=P(Z>z).}

| Forudsigelse interval |

z |

|---|---|

| 75% | 1.15 |

| 90% | 1.64 |

| 95% | 1.96 |

| 99% | 2,58 |

Prædiktionsintervallet skrives konventionelt som:

. {\displaystyle \left.}

For eksempel skal man for at beregne 95%-prædiktionsintervallet for en normalfordeling med en middelværdi (µ) på 5 og en standardafvigelse (σ) på 1 beregne, at z er ca. 2. Derfor er den nedre grænse for forudsigelsesintervallet ca. 5 – (2-1) = 3, og den øvre grænse er ca. 5 + (2-1) = 7, hvilket giver et forudsigelsesinterval på ca. 3 til 7.

Estimering af parametreRediger

For en fordeling med ukendte parametre er en direkte tilgang til forudsigelse at estimere parametrene og derefter bruge den tilhørende kvantilfunktion – f.eks. kunne man bruge stikprøvens gennemsnit X ¯ {\displaystyle {\overline {X}}}

som estimat for μ og stikprøvevariansen s2 som et estimat for σ2. Bemærk, at der er to naturlige valg for s2 her – at dividere med ( n – 1 ) {\displaystyle (n-1)}

giver et ubiased estimat, mens division med n giver maximum likelihood estimator, og begge dele kan anvendes. Man bruger derefter kvantilfunktionen med disse estimerede parametre Φ X ¯ , s 2 – 1 {\displaystyle \Phi _{{{\overline {X}}},s^{2}}}^{-1}}}

til at give et forudsigelsesinterval.

Denne fremgangsmåde er brugbar, men det resulterende interval vil ikke have den gentagne prøveudtagningsfortolkning – det er ikke et prædiktivt konfidensinterval.

I fortsættelsen anvendes stikprøvens gennemsnit:

X ¯ = X ¯ n = ( X 1 + ⋯ + X n ) / n {\displaystyle {\overline {X}}={\overline {X}}_{n}=(X_{1}+\cdots +X_{n})/n}

og den (uforbevidste) stikprøvevarians:

s 2 = s n 2 = 1 n – 1 ∑ i = 1 n ( X i – X ¯ n ) 2 . {\displaystyle s^{2}=s_{n}^{2}={1 \over n-1}\sum _{i=1}^{n}(X_{i}-{\overline {X}}}_{n})^{2}.}

Ukendt middelværdi, kendt variansRediger

Givet en normalfordeling med ukendt middelværdi μ, men kendt varians 1, er stikprøvens middelværdi X ¯ {\displaystyle {\overline {X}}}}

af observationerne X 1 , … , X n {\displaystyle X_{1},\dots ,X_{n}}}

har fordelingen N ( μ , 1 / n ) , {\displaystyle N(\mu ,1/n),}

mens den fremtidige observation X n + 1 {\displaystyle X_{n+1}}

har fordelingen N ( μ , 1 ) . {\displaystyle N(\mu ,1).}

Ved at tage forskellen af disse annulleres μ og man får en normalfordeling med varians 1 + ( 1 / n ) , {\displaystyle 1+(1/n),}

således X n + 1 – X ¯ 1 + ( 1 / n ) ∼ N ( 0 , 1 ) . {\displaystyle {\frac {X_{n+1}-{\overline {X}}}{\sqrt {1+(1/n)}}}}\sim N(0,1).}

Solving for X n + 1 {\displaystyle X_{n+1}}}

giver forudsigelsesfordelingen N ( X ¯ , 1 + ( 1 / n ) ) , { {\displaystyle N({\overline {X}}},1+(1/n)),}

, hvorfra man kan beregne intervaller som før. Dette er et prædiktivt konfidensinterval i den forstand, at hvis man anvender et kvantilinterval på 100p%, så vil den fremtidige observation X n + 1 {\displaystyle X_{n+1}}

vil falde i det forudsagte interval i 100p% af tilfældene.

Bemærk, at denne forudsigelsesfordeling er mere konservativ end at bruge den estimerede middelværdi X ¯ {{\displaystyle {\overline {X}}}}

og den kendte varians 1, da dette bruger varians 1 + ( 1 / n ) {\displaystyle 1+(1/n)}

, og giver derfor bredere intervaller. Dette er nødvendigt, for at den ønskede egenskab ved konfidensintervaller kan holde.

Kendt middelværdi, ukendt variansRediger

Og omvendt, givet en normalfordeling med kendt middelværdi 0, men ukendt varians σ 2 {\displaystyle \sigma ^{2}}

, er stikprøvevariansen s 2 {\displaystyle s^{2}}

af observationerne X 1 , … , X n {\displaystyle X_{1},\dots ,X_{n}}

har, op til skalaen, a χ n – 1 2 {\displaystyle \scriptstyle \chi _{n-1}^{2}}}

fordeling; mere præcist: ( n – 1 ) s n 2 σ 2 ∼ χ n – 1 2 . {\displaystyle {\frac {(n-1)s_{n}^{2}}}{\sigma ^{2}}}\sim \chi _{n-1}^{2}.}

mens den fremtidige observation X n + 1 {\displaystyle X_{n+1}}

har fordelingen N ( 0 , σ 2 ) . {\displaystyle N(0,\sigma ^{2}).} {\displaystyle N(0,\sigma ^{2}).}

Ved at tage forholdet mellem den fremtidige observation og stikprøvens standardafvigelse annulleres σ, hvilket giver en Student’s t-fordeling med n – 1 frihedsgrader: X n + 1 s ∼ T n – 1 . {\displaystyle {\frac {\frac {X_{n+1}}}{s}}}\sim T^{n-1}.}

Solving for X n + 1 {\displaystyle X_{n+1}}}

giver forudsigelsesfordelingen s T n – 1 , {\displaystyle sT^{n-1},}

hvorfra man kan beregne intervaller som før.

Bemærk, at denne forudsigelsesfordeling er mere konservativ end at bruge en normalfordeling med den estimerede standardafvigelse s {\displaystyle s}

og kendt middelværdi 0, da den anvender t-fordelingen i stedet for normalfordelingen og dermed giver bredere intervaller. Dette er nødvendigt, for at den ønskede egenskab ved konfidensintervaller kan holde.

Ukendt middelværdi, ukendt variansRediger

Kombination af ovenstående for en normalfordeling N ( μ , σ 2 ) {\displaystyle N(\mu ,\sigma ^{2})}

med både μ og σ2 ukendt giver følgende supplerende statistik: X n + 1 – X ¯ n s n n 1 + 1 + 1 / n ∼ T n – 1 . {\displaystyle {\frac {X_{n+1}-{\overline {X}}_{n}}}{s_{n}{\sqrt {1+1/n}}}}\sim T^{n-1}.}

Denne enkle kombination er mulig, fordi stikprøvens middelværdi og stikprøvevarians i normalfordelingen er uafhængige statistikker; dette gælder kun for normalfordelingen og karakteriserer faktisk normalfordelingen.

Løsning for X n + 1 {\displaystyle X_{n+1}}

giver forudsigelsesfordelingen X ¯ n + s n 1 + 1 + 1 / n ⋅ T n – 1 . {\displaystyle {\overline {\overline {X}}}_{n}+s_{n}{\sqrt {1+1/n}}}\cdot T^{n-1}.}

Sandsynligheden for X n + 1 {\displaystyle X_{n+1}}

falder i et givet interval er da: Pr ( X ¯ n – T a s n 1 + ( 1 / n ) ≤ X n + 1 ≤ X ¯ n + T a s n 1 + ( 1 / n ) ) = p {\displaystyle \Pr \left({\overline {X}}}_{n}-T_{a}s_{n}{\sqrt {1+(1/n)}}\leq X_{n+1}\leq {\overline {X}}}_{n}+T_{a}s_{n}{{\sqrt {1+(1/n)}}}\,\right)=p}