Givet ett prov från en normalfördelning, vars parametrar är okända, är det möjligt att ge prognosintervall i frekventistisk mening, det vill säga, ett intervall baserat på statistik över urvalet som gör att Xn+1 vid upprepade experiment faller i intervallet den önskade procentandelen av tiden; man kan kalla dessa ”prediktiva konfidensintervall”.

En allmän teknik för frekventa prediktionsintervall är att hitta och beräkna en central kvantitet av de observerbara variablerna X1, …., Xn, Xn+1 – dvs. en funktion av observabler och parametrar vars sannolikhetsfördelning inte beror på parametrarna – som kan inverteras för att ge en sannolikhet för att den framtida observationen Xn+1 ska falla i ett intervall som beräknas utifrån de observerade värdena hittills, X 1 , … , X n . {\displaystyle X_{1},\dots ,X_{n}.}

En sådan central kvantitet, som endast är beroende av observabler, kallas för en hjälpstatistik. Den vanliga metoden för att konstruera pivotala storheter är att ta skillnaden mellan två variabler som beror på platsen, så att platsen upphävs, och sedan ta förhållandet mellan två variabler som beror på skalan, så att skalan upphävs. den mest välkända pivotala storheten är studentens t-statistik, som kan härledas med denna metod och som används i fortsättningen.

Känt medelvärde, känd variansRedigera

Ett prediktionsintervall för en framtida observation X i en normalfördelning N(µ,σ2) med känt medelvärde och varians kan beräknas från

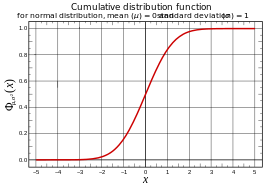

γ = P ( ℓ < X < u ) = P ( ℓ – μ σ < X – μ σ σ < u – μ σ ) = P ( ℓ – μ σ σ < Z < u – μ σ ) , {\displaystyle \gamma =P(\ell <X<u)=P\left({\frac {\ell -\mu }{\sigma }}<{\frac {X-\mu }{\sigma }}<{\frac {u-\mu }{\sigma }}\right)=P\left({\frac {\frac {\ell -\mu }{\sigma }}<Z<{\frac {u-\mu }{\sigma }}\right),}

varvid Z = X – μ σ {\displaystyle Z={\frac {X-\mu }{\sigma }}}

, standardpoängen för X, fördelas som standardnormal.

Härav

ℓ – μ σ = – z , u – μ σ = z , {\displaystyle {\frac {\ell -\mu }{\sigma }}=-z,\quad {\frac {u-\mu }{\sigma }}=z,}

eller

ℓ = μ – z σ , u = μ + z σ , {\displaystyle \ell =\mu -z\sigma ,\quad u=\mu +z\sigma ,}

med z kvantilen i standardnormalfördelningen för vilken:

γ = P ( – z < Z < z ) . {\displaystyle \gamma =P(-z<Z<z).}

eller motsvarande;

1 2 ( 1 – γ ) = P ( Z > z ) . {\displaystyle {\tfrac {1}{2}}}(1-\gamma )=P(Z>z).}

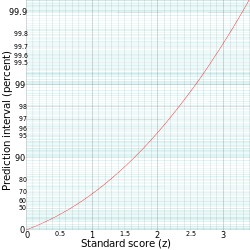

| Prediktion intervall |

z |

|---|---|

| 75% | 1.15 |

| 90% | 1.64 |

| 95% | 1.96 |

| 99% | 2,58 |

Prediktionsintervallet skrivs konventionellt som:

. {\displaystyle \left.}

För att till exempel beräkna det 95-procentiga prediktionsintervallet för en normalfördelning med ett medelvärde (µ) på 5 och en standardavvikelse (σ) på 1, så är z ungefär 2. Därför är den nedre gränsen för prediktionsintervallet ungefär 5 – (2-1) = 3, och den övre gränsen är ungefär 5 + (2-1) = 7, vilket ger ett prediktionsintervall på ungefär 3 till 7.

Skattning av parametrarRedigera

För en fördelning med okända parametrar är ett direkt tillvägagångssätt för prediktion att skatta parametrarna och sedan använda den tillhörande kvantilfunktionen – till exempel kan man använda provets medelvärde X ¯ {\displaystyle {\overline {X}}}

som skattning för μ och urvalets varians s2 som en skattning för σ2. Observera att det finns två naturliga val för s2 här – att dividera med ( n – 1 ) {\displaystyle (n-1)}

ger en fördomsfri skattning, medan dividering med n ger maximal sannolikhetsskattning, och båda kan användas. Man använder sedan kvantilfunktionen med dessa uppskattade parametrar Φ X ¯ , s 2 – 1 {\displaystyle \Phi _{{{\overline {X}},s^{2}}}^{-1}}}

för att ge ett prediktionsintervall.

Detta tillvägagångssätt är användbart, men det resulterande intervallet kommer inte att ha tolkningen av upprepad provtagning – det är inte ett prediktivt konfidensintervall.

För fortsättningen använder vi stickprovsmedelvärdet:

X ¯ = X ¯ n = ( X 1 + ⋯ + X n ) / n {\displaystyle {\overline {X}}={\overline {X}}_{n}=(X_{1}+\cdots +X_{n})/n}

och den (fördomsfria) stickprovsvariansen:

s 2 = s n 2 = 1 n – 1 ∑ i = 1 n ( X i – X ¯ n ) 2 . {\displaystyle s^{2}=s_{n}^{2}={1 \over n-1}\sum _{i=1}^{n}(X_{i}-{\overline {X}}_{n})^{2}.}

Okänt medelvärde, känd variansRedigera

Givet en normalfördelning med okänt medelvärde μ men känd varians 1, kan provets medelvärde X ¯ {\displaystyle {\overline {X}}}

av observationerna X 1 , … , X n {\displaystyle X_{1},\dots ,X_{n}}}

har fördelningen N ( μ , 1 / n ) , {\displaystyle N(\mu ,1/n),}

medan den framtida observationen X n + 1 {\displaystyle X_{n+1}}

har fördelningen N ( μ , 1 ) . {\displaystyle N(\mu ,1).}

Genom att ta skillnaden mellan dessa upphävs μ och man får en normalfördelning med varians 1 + ( 1 / n ) , {\displaystyle 1+(1/n),}

alltså X n + 1 – X ¯ 1 + ( 1 / n ) ∼ N ( 0 , 1 ) . {\displaystyle {\frac {X_{n+1}-{\overline {X}}}{\sqrt {1+(1/n)}}}}\sim N(0,1).}

Lösning för X n + 1 {\displaystyle X_{n+1}}}

ger prediktionsfördelningen N ( X ¯ , 1 + ( 1 / n ) ) , {\displaystyle N({\overline {X}}},1+(1/n)),}

från vilken man kan beräkna intervaller som tidigare. Detta är ett prediktivt konfidensintervall i den meningen att om man använder ett kvantilintervall på 100p%, så kommer den framtida observationen X n + 1 {\displaystyle X_{n+1}}

falla i det förutspådda intervallet i 100p% av fallen.

Märk att denna prediktionsfördelning är mer konservativ än att använda det uppskattade medelvärdet X ¯ {\displaystyle {\overline {X}}}

och känd varians 1, eftersom detta använder varians 1 + ( 1 / n ) {\displaystyle 1+(1/n)}

, vilket ger bredare intervall. Detta är nödvändigt för att den önskade konfidensintervallegenskapen ska gälla.

Känt medelvärde, okänd variansRedigera

Omvänt, givet en normalfördelning med känt medelvärde 0 men okänd varians σ 2 {\displaystyle \sigma ^{2}}

, är provvariansen s 2 {\displaystyle s^{2}}

av observationerna X 1 , … , X n {\displaystyle X_{1},\dots ,X_{n}}}

har, upp till skalan, a χ n – 1 2 {\displaystyle \scriptstyle \chi _{n-1}^{2}}}

fördelning; mer exakt: ( n – 1 ) s n 2 σ 2 ∼ χ n – 1 2 . {\displaystyle {\frac {(n-1)s_{n}^{2}}}{\sigma ^{2}}}\sim \chi _{n-1}^{2}.}

medan den framtida observationen X n + 1 {\displaystyle X_{n+1}}

har fördelningen N ( 0 , σ 2 ) . {\displaystyle N(0,\sigma ^{2}).

Genom att ta förhållandet mellan den framtida observationen och urvalets standardavvikelse upphävs σ, vilket ger en Student’s t-fördelning med n – 1 frihetsgrader: X n + 1 s ∼ T n – 1 . {\displaystyle {\frac {X_{n+1}}}{s}}\sim T^{n-1}.}

Lösning för X n + 1 {\displaystyle X_{n+1}}

ger prediktionsfördelningen s T n – 1 , {\displaystyle sT^{n-1},}

från vilken man kan beräkna intervaller som tidigare.

Observera att denna prediktionsfördelning är mer konservativ än att använda en normalfördelning med den uppskattade standardavvikelsen s {\displaystyle s}

och känt medelvärde 0, eftersom den använder t-fördelningen i stället för normalfördelningen och därmed ger bredare intervall. Detta är nödvändigt för att den önskade konfidensintervallegenskapen ska gälla.

Okänt medelvärde, okänd variansRedigera

Kombinera ovanstående för en normalfördelning N ( μ , σ 2 ) {\displaystyle N(\mu ,\sigma ^{2})}

med både μ och σ2 okända ger följande kompletterande statistik: X n + 1 – X ¯ n s n n 1 + 1 / n ∼ T n – 1 . {\displaystyle {\frac {X_{n+1}-{\overline {X}}_{n}}}{s_{n}{\sqrt {1+1/n}}}}\sim T^{n-1}.}

Denna enkla kombination är möjlig eftersom provets medelvärde och provets varians för normalfördelningen är oberoende statistik; detta gäller endast för normalfördelningen och kännetecknar i själva verket normalfördelningen.

Lösning för X n + 1 {\displaystyle X_{n+1}}

ger prediktionsfördelningen X ¯ n + s n 1 + 1 / n ⋅ T n – 1 . {\displaystyle {\overline {X}}}_{n}+s_{n}{\sqrt {1+1/n}}\cdot T^{n-1}.}

Sannolikheten för X n + 1 {\displaystyle X_{n+1}}

som faller i ett givet intervall är då: Pr ( X ¯ n – T a s n 1 + ( 1 / n ) ≤ X n + 1 ≤ X ¯ n + T a s n 1 + ( 1 / n ) ) = p {\displaystyle \Pr \left({\overline {X}}_{n}-T_{a}s_{n}{\sqrt {1+(1/n)}}\leq X_{n+1}\leq {\overline {X}}_{n}+T_{a}s_{n}{\sqrt {1+(1/n)}}\\,\right)=p}