Dando uma amostra de uma distribuição normal, cujos parâmetros são desconhecidos, é possível dar intervalos de previsão no sentido frequentista, ou seja um intervalo baseado em estatísticas da amostra de tal forma que, em experiências repetidas, Xn+1 cai no intervalo a percentagem desejada do tempo; pode-se chamar estes “intervalos de confiança preditiva”.

Uma técnica geral de intervalos de predição frequentista é encontrar e computar uma quantidade pivotal dos observáveis X1, …., Xn, Xn+1 – significando uma função de observáveis e parâmetros cuja distribuição de probabilidade não depende dos parâmetros – que pode ser invertida para dar uma probabilidade da observação futura Xn+1 cair em algum intervalo computado em termos dos valores observados até agora, X 1 , … , X n . X_{{1},}dots,X_{n}.}

Tal quantidade pivotal, dependendo apenas dos observáveis, é chamada de estatística auxiliar. O método usual de construir quantidades pivô é pegar a diferença de duas variáveis que dependem da localização, para que a localização cancele, e então pegar a razão de duas variáveis que dependem da escala, para que a escala cancele.A quantidade pivô mais familiar é a estatística t de Aluno, que pode ser derivada por este método e é usada na seqüência.

Média conhecida, variância conhecidaEditar

Um intervalo de previsão para uma futura observação X em uma distribuição normal N(µ,σ2) com média e variância conhecidas podem ser calculadas a partir de

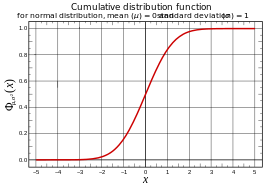

γ = P ( ℓ < X < u ) = P ( ℓ – μ σ < X – μ σ < u – μ σ ) = P ( ℓ – μ σ < Z < u – μ σ ) , estilo de jogo =P(bem <X<u)=Pesquerda(bem -mu -mu}{\i}{\i}{\i1}5834>frac =P(bem -mu}{\i}{\i}}frac =P(bem <X-\i}{\i}{\i}{\i}{\i1}frac\Mu Sigma (Direita) =Pesquerda (Frac) =Pesquerda (Frac) =Pesquerda (Bell) =Mu Sigma (Sigma) =5834>Z (Z) =5834>Frac (U-Mu Sigma (Direita) =Pesquerda (Frac) =Pesquerda (Frac)

where Z = X – μ σ {\displaystyle Z={\frac {\frac {\mu }}{\sigma }}

, a pontuação padrão de X, é distribuída como padrão normal.

Hence

ℓ – μ σ = – z , u – μ σ = z , {\\frac {\frac {\sigma }}=-z,\quad {\frac {\mu }=z,}

ou

ℓ = μ – z σ , u = μ + z σ , {\i1}displaystyle {\i}ell =\i -zsigma ,{\i}quad u=\i +z\sigma ,}

com z o quantil na distribuição normal para a qual:

γ = P ( – z < Z < z ) . {\gamma =P(-z<Z<z).}

ou equivalente;

1 2 ( 1 – γ ) = P ( Z > z ) . {\i1}{\i1}{\i1}(1-}gamma )=P(Z>z).}

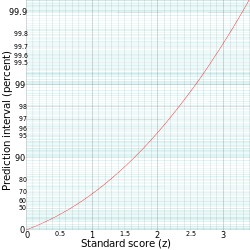

| Previsão intervalo |

z |

|---|---|

| 75% | 1.15 |

| 90% | 1.64 |

| 95% | 1.96 |

| 99% | 2,58 |

O intervalo de previsão é convencionalmente escrito como:

. {\i1}esquerda.{\i}

Por exemplo, para calcular o intervalo de predição de 95% para uma distribuição normal com uma média (µ) de 5 e um desvio padrão (σ) de 1, então z é aproximadamente 2. Portanto, o limite inferior do intervalo de predição é aproximadamente 5 – (2-1) = 3, e o limite superior é aproximadamente 5 + (2-1) = 7, dando assim um intervalo de predição de aproximadamente 3 a 7,

Estimativa dos parâmetrosEditar

Para uma distribuição com parâmetros desconhecidos, uma abordagem directa à previsão é estimar os parâmetros e depois usar a função de quantil associada – por exemplo, pode-se usar a média amostral X ¯ {\displaystyle {\displaystyle {\displaystyle {\displaystyle {\displaystyle {X}}}

como estimativa para μ e a variância amostral s2 como estimativa para σ2. Note que existem duas escolhas naturais para a s2 aqui – dividindo por ( n – 1 ) {\\i1} {\i1}displaystyle (n-1)}

produz uma estimativa imparcial, enquanto dividindo por n rendimentos o estimador de máxima verosimilhança, e qualquer um dos dois pode ser usado. Utiliza-se então a função quantil com estes parâmetros estimados Φ X ¯ , s 2 – 1 {\i1}displaystyle \i _{\i1},s^{\i}{\i1}^{\i1}}}Phi _{\i1}overline {\i},s^{\i}{\i}}

para dar um intervalo de previsão.

Esta abordagem é utilizável, mas o intervalo resultante não terá a interpretação de amostragem repetida – não é um intervalo de confiança preditiva.

e a variância da amostra (imparcial):

s 2 = s n 2 = 1 n – 1 ∑ i = 1 n ( X i – X ¯ n ) 2 . s^{2}=s_{n}^{2}={1 {1 ^ sobre n-1}}sum _{i=1}^{n}(X_{i}-{\i}-{\i}- sobrelinha ^{X}}_{n})^{2}.}

Média desconhecida, variância conhecidaEditar

Dada uma distribuição normal com média desconhecida μ mas variância conhecida 1, a média da amostra X ¯ ¯ ¯ média da amostra ¯ sobrelinha ¯

das observações X 1 , … , X n {\i1}displaystyle X_{\i},{\i}dots ,X_{n}}

tem distribuição N ( μ , 1 / n ) , {\i1}displaystyle N(\i ,1/n),}

enquanto a observação futura X n + 1 {\i}displaystyle X_{n+1}}

tem distribuição N ( μ , 1 ) . N(\mu ,1).}

Tomando a diferença destes cancela o μ e produz uma distribuição normal de variância 1 + ( 1 / n ) , {\displaystyle 1+(1/n),}

assim X n + 1 – X ¯ 1 + ( 1 / n ) ∼ N ( 0 , 1 ) . estilo de exibição {\frac {X_{n+1}-{\i1}-{\i1}{\i1+(1/n)}}sim N(0,1).{\i}

Solving for X n + 1 {\i1}displaystyle X_{n+1}}

dá a distribuição da previsão N ( X ¯ , 1 + ( 1 / n ) ) {\i1},1+(1/n)),}

a partir do qual se pode calcular intervalos como antes. Este é um intervalo de confiança preditivo no sentido de que se se usar um intervalo de quantil de 100p%, então em aplicações repetidas deste cálculo, a observação futura X n + 1 {\displaystyle X_{n+1}}

cairá no intervalo previsto 100p% do tempo.

Note que esta distribuição de previsão é mais conservadora do que usar a média estimada de X ¯ ¯ estilo de exibição {\i1}{\i1}

e variância conhecida 1, pois esta usa variância 1 + ( 1 / n ) {\displaystyle 1+(1/n)}

, portanto, produz intervalos mais amplos. Isto é necessário para que a propriedade do intervalo de confiança desejado se mantenha.

Variância média conhecida e desconhecidaEditar

Conversamente, dada uma distribuição normal com variância média conhecida 0 mas desconhecida σ 2 ^{\i1}displaystyle ^{\i}

, a variância da amostra s 2 ^{\i1}systyle s^{\i}}

das observações X 1 , … , X n {\i1}displaystyle X_{\i},{\i}dots ,X_{n}}

tem, até à escala, um χ n – 1 2 {\i1}displaystyle {\i}scriptstyle {\i} {\i _{n-1}^{\i}

distribuição; mais precisamente: ( n – 1 ) s n 2 σ 2 ∼ χ n – 1 2 . estilo de jogo {\frac {\n-1}^{2}{\i}{\i1}{\i1}sigma {\i}sim {\i}chi _\n-1}{\i}{\i}

enquanto a observação futura X n + 1 {\i1}displaystyle X_{n+1}}

tem distribuição N ( 0 , σ 2 ) . N(0,^^sigma ^{2}).}

Tomando a proporção da observação futura e o desvio padrão da amostra cancela o σ, produzindo a distribuição t de um Aluno com n – 1 graus de liberdade: X n + 1 s ∼ T n – 1 . estilo de exibição {\frac {X_{n+1}{s}}sim T^{n-1}.}

Solvendo para X n + 1 {\i1}displaystyle X_{n+1}}

dá a distribuição da previsão s T n – 1 , {\i1}displaystyle sT^{n-1},}

a partir da qual se pode calcular intervalos como antes.

Note que esta distribuição de previsão é mais conservadora do que usar uma distribuição normal com o desvio padrão estimado s {\i1}displaystyle s

e média 0 conhecida, pois usa a distribuição em t em vez da distribuição normal, produzindo assim intervalos mais amplos. Isto é necessário para que a propriedade do intervalo de confiança desejado se mantenha.

Média desconhecida, variância desconhecidaEditar

Combinando o acima para uma distribuição normal N ( μ , σ 2 ) {\displaystyle N(\mu ,\sigma ^{2})}

com μ e σ2 unknown yields the following ancillary statistic: X n + 1 – X ¯ n s n 1 + 1 / n ∼ T n – 1 . {\i1}{s_{\i}{\i}{sqrt {1+1/n}}}}}sim T^{n-1}.}

Esta combinação simples é possível porque a média amostral e a variância amostral da distribuição normal são estatísticas independentes; isto só é verdade para a distribuição normal, e na verdade caracteriza a distribuição normal.

Solução para X n + 1 {\displaystyle X_{n+1}}

produz a distribuição de previsão X ¯ n + s n 1 + 1 / n ⋅ T n – 1 . estilo de exibição ^{n-1}_{n}+s_{n}{sqrt {1+1/n}}cdot T^{n-1}.}

A probabilidade de X n + 1 {\i1}displaystyle X_{n+1}}{\i1}

caindo em um dado intervalo é então: Pr ( X ¯ n – T a s n 1 + ( 1 / n ) ≤ X n + 1 ≤ X ¯ n + T a s n 1 + ( 1 / n ) ) = p {\i1}- p {\i1}-T_{a}s_{n}{n}{sqrt {1+(1/n)}leq X_{n+1}leq {n+1}leq {\i}{n}+T_{a}s_{n}{n}{sqrt {1+(1/n)},{\i1}direito)=p}