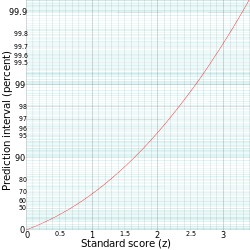

Dato un campione da una distribuzione normale, i cui parametri sono sconosciuti, è possibile dare intervalli di predizione in senso frequentista, cioè, un intervallo basato sulla statistica del campione tale che su esperimenti ripetuti, Xn+1 cade nell’intervallo la percentuale desiderata di volte; si possono chiamare “intervalli di confidenza predittivi”.

Una tecnica generale di intervalli di predizione frequentista è trovare e calcolare una quantità cardine delle osservabili X1, …., Xn, Xn+1 – cioè una funzione di osservabili e parametri la cui distribuzione di probabilità non dipende dai parametri – che può essere invertita per dare una probabilità che l’osservazione futura Xn+1 cada in un certo intervallo calcolato in termini dei valori osservati finora, X 1 , … , X n . {\displaystyle X_{1},\punti ,X_{n}.}

Una tale quantità pivotale, dipendente solo da osservabili, è chiamata statistica ausiliaria. Il metodo usuale per costruire le quantità cardine è quello di prendere la differenza di due variabili che dipendono dalla posizione, in modo che la posizione si annulli, e poi prendere il rapporto di due variabili che dipendono dalla scala, in modo che la scala si annulli.La quantità cardine più familiare è la statistica t di Student, che può essere derivata con questo metodo e viene utilizzata nel seguito.

Media nota, varianza notaModifica

Un intervallo di previsione per un’osservazione futura X in una distribuzione normale N(µ,σ2) con media e varianza note può essere calcolato da

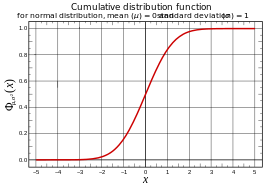

γ = P ( ℓ < X < u ) = P ( ℓ – μ σ < X – μ σ < u – μ σ ) = P ( ℓ – μ σ < Z < u – μ σ ) , {\displaystyle \gamma =P(\ell <X<u)=P\left({frac {\frac {\ell -\mu }{sigma }<{frac {X-\mu }{sigma }<{\frac {u-\)=P\sinistra({\frac {ell -\mu }<Z<{frac {u-\mu}<{frac {u-\mu }{sigma}}destra),}

dove Z = X – μ σ {\displaystyle Z={frac {X-\mu }{sigma }}

, il punteggio standard di X, è distribuito come normale standard.

Quindi

ℓ – μ σ = – z , u – μ σ = z , {\displaystyle {\frac {\ell -\mu }{sigma }=-z,\quad {\frac {u-\mu }=z,}

o

ℓ = μ – z σ , u = μ + z σ , {displaystyle \ell =\mu -z\sigma,\quad u=\mu +z\sigma,}

con z il quantile nella distribuzione normale standard per cui:

γ = P ( – z < Z < z ) . {\displaystyle \gamma =P(-z<Z<z).}

o equivalentemente;

1 2 ( 1 – γ ) = P ( Z > z ) . (1 – γ )=P(Z>z )=P(1 – γ )=P(Z>z ).

| Previsione intervallo |

z |

|---|---|

| 75% | 1.15 |

| 90% | 1.64 |

| 95% | 1.96 |

| 99% | 2.58 |

L’intervallo di previsione è convenzionalmente scritto come:

. {\displaystyle \left.}

Per esempio, per calcolare l’intervallo di predizione del 95% per una distribuzione normale con una media (µ) di 5 e una deviazione standard (σ) di 1, allora z è circa 2. Pertanto, il limite inferiore dell’intervallo di previsione è approssimativamente 5 – (2-1) = 3, e il limite superiore è approssimativamente 5 + (2-1) = 7, dando così un intervallo di previsione di circa 3 a 7.

Stima dei parametriModifica

Per una distribuzione con parametri sconosciuti, un approccio diretto alla previsione è quello di stimare i parametri e poi usare la funzione quantile associata – per esempio, si potrebbe usare la media del campione X ¯ {displaystyle {\overline {X}}}

come stima per μ e la varianza campionaria s2 come stima per σ2. Si noti che ci sono due scelte naturali per s2 qui – dividendo per ( n – 1 ) {\displaystyle (n-1)}

produce una stima imparziale, mentre dividendo per n si ottiene lo stimatore di massima verosimiglianza, e si possono usare entrambi. Si usa quindi la funzione quantile con questi parametri stimati Φ X ¯ , s 2 – 1 {\displaystyle \Phi _{{overline {X}},s^{2}}^{-1}}

per dare un intervallo di previsione.

Questo approccio è utilizzabile, ma l’intervallo risultante non avrà l’interpretazione di campionamento ripetuto – non è un intervallo di confidenza predittivo.

Per il seguito, usare la media del campione:

X ¯ = X ¯ n = ( X 1 + ⋯ + X n ) / n {\displaystyle {\overline {X}}={overline {X}}_{n}=(X_{1}+\punti +X_{n})/n}

e la varianza campionaria (imparziale):

s 2 = s n 2 = 1 n – 1 ∑ i = 1 n ( X i – X ¯ n ) 2 . {\displaystyle s^{2}=s_{n}^{2}={1 \over n-1}\sum _{i=1}^{n}(X_{i}-{overline {X}}_{n})^{2}.}

Media sconosciuta, varianza notaModifica

Data una distribuzione normale con media sconosciuta μ ma varianza nota 1, la media del campione X ¯ {displaystyle {\overline {X}}}

delle osservazioni X 1 , … , X n {\displaystyle X_{1},\punti ,X_{n}}

ha distribuzione N ( μ , 1 / n ) , {\displaystyle N(\mu ,1/n),}

mentre l’osservazione futura X n + 1 {\displaystyle X_{n+1}

ha distribuzione N ( μ , 1 ) . {\displaystyle N(\mu ,1).}

Prendendo la differenza di questi annulla il μ e produce una distribuzione normale di varianza 1 + ( 1 / n ) , {\displaystyle 1+(1/n),}

quindi X n + 1 – X ¯ 1 + ( 1 / n ) ∼ N ( 0 , 1 ) . {Il risultato è che X n + 1 – X ¯ 1 + ( 1 / n ) ∼ N ( 0 , 1 ) è il risultato di una combinazione di X n + 1 – X ¯ 1 + ( 1 / n ) ∼ N ( 0 , 1 ) .

Risolvendo per X n + 1 {\displaystyle X_{n+1}}

dà la distribuzione di previsione N ( X ¯ , 1 + ( 1 / n ) ) , {\displaystyle N({\overline {X}},1+(1/n)),}

da cui si possono calcolare intervalli come prima. Questo è un intervallo di confidenza predittivo nel senso che se si usa un intervallo quantile del 100p%, allora su applicazioni ripetute di questo calcolo, l’osservazione futura X n + 1 {\displaystyle X_{n+1}}

cadrà nell’intervallo previsto il 100p% delle volte.

Si noti che questa distribuzione di previsione è più conservativa dell’uso della media stimata di X ¯ {displaystyle {overline {X}}}

e la varianza nota 1, poiché questa utilizza la varianza 1 + ( 1 / n ) {\displaystyle 1+(1/n)}

, quindi produce intervalli più ampi. Questo è necessario per mantenere la proprietà dell’intervallo di confidenza desiderata.

Media nota, varianza sconosciutaModifica

Inversamente, data una distribuzione normale con media nota 0 ma varianza sconosciuta σ 2 {displaystyle \sigma ^{2}

, la varianza campione s 2 {displaystyle s^{2}

delle osservazioni X 1 , … , X n {\displaystyle X_{1},\punti ,X_{n}}

ha, fino alla scala, a χ n – 1 2 {\displaystyle \scriptstyle \chi _{n-1}^{2}}

; più precisamente: ( n – 1 ) s n 2 σ 2 ∼ χ n – 1 2 . {displaystyle {\frac {(n-1)s_{n}^{2}}{sigma ^{2}}}{sim \chi _{n-1}^{2}.}

mentre l’osservazione futura X n + 1 {\displaystyle X_{n+1}

ha distribuzione N ( 0 , σ 2 ) . {\displaystyle N(0,\sigma ^{2}).

Prendendo il rapporto tra l’osservazione futura e la deviazione standard del campione si annulla la σ, ottenendo una distribuzione t di Student con n – 1 gradi di libertà: X n + 1 s ∼ T n – 1 . {La distribuzione t di Student con n – 1 gradi di libertà è la seguente: X n + 1 s ∼ T n – 1 .

Solvendo per X n + 1 {\displaystyle X_{n+1}}

dà la distribuzione di previsione s T n – 1 , {displaystyle sT^{n-1},}

da cui si possono calcolare gli intervalli come prima.

Si noti che questa distribuzione di previsione è più conservativa dell’uso di una distribuzione normale con la deviazione standard stimata s {\displaystyle s}

e media nota 0, poiché utilizza la distribuzione t invece della distribuzione normale, e quindi produce intervalli più ampi. Questo è necessario per mantenere la proprietà dell’intervallo di confidenza desiderata.

Media sconosciuta, varianza sconosciutaModifica

Combinando quanto sopra per una distribuzione normale N ( μ , σ 2 ) {\displaystyle N(\mu ,\sigma ^{2})}

con entrambi μ e σ2 sconosciuti produce la seguente statistica accessoria: X n + 1 – X ¯ n s n 1 + 1 / n ∼ T n – 1 . {displaystyle {{frac {X_{n+1}-{overline {X}}_{n}}{s_{n}{sqrt {1+1/n}}}}\sim T^{n-1}.}

Questa semplice combinazione è possibile perché la media campionaria e la varianza campionaria della distribuzione normale sono statistiche indipendenti; questo è vero solo per la distribuzione normale, e infatti caratterizza la distribuzione normale.

Solvendo per X n + 1 {\displaystyle X_{n+1}}

si ottiene la distribuzione di previsione X ¯ n + s n 1 + 1 / n ⋅ T n – 1 . {displaystyle {overline {X}}_{n}+s_{n}{sqrt {1+1/n}}cdot T^{n-1}.}

La probabilità di X n + 1 {\displaystyle X_{n+1}

cadendo in un dato intervallo è quindi: Pr ( X ¯ n – T a s n 1 + ( 1 / n ) ≤ X n + 1 ≤ X ¯ n + T a s n 1 + ( 1 / n ) ) = p {\displaystyle \Pr \left({\overline {X}}_{n}-T_a}s_{n}{sqrt {1+(1/n)}}leq X_{n+1}{leq {{overline {X}}_{n}+T_a}s_{n}{sqrt {1+(1/n)},\destra)=p}